YAPAY ZEKA ZORLUKLARI

Mevcut mimarilerin bilişsel yetenekleri, zekanın gerçekten yapabileceklerinin yalnızca basitleştirilmiş bir versiyonunu kullanarak çok sınırlıdır. Örneğin, insan zihni hayattaki farklı olaylara ölçüsüz bir mantık ve mantıksal açıklamalar getirmenin yollarını buldu. Aksi takdirde basit olan bir şey, aynı derecede zor bir problemin insan aklını kullanmak yerine sayısal olarak çözülmesi zor olabilir. Bu, iki sınıf modele yol açar: yapısalcı ve işlevselcdir. Yapısal modeller, akıl yürütme ve mantık gibi zihnin temel zeka işlemlerini gevşek bir şekilde taklit etmeyi amaçlar. Fonksiyonel model, ilişkili verileri, hesaplanan muadili ile ilgilidir. [85]

Yapay zekanın genel araştırma hedefi, bilgisayarların ve makinelerin akıllı bir şekilde çalışmasına izin veren bir teknoloji yaratmaktır. Genel zeka simülasyonu (veya yaratma) problemi alt problemlere bölünmüştür. Bunlar, araştırmacıların akıllı bir sistemin göstermesini beklediği belirli özelliklerden veya yeteneklerden oluşur. En çok ilgiyi aşağıda açıklanan özellikler almıştır. [16]

AKIL YÜRÜTME – SORUN ÇÖZME

İlk araştırmacılar, insanların bulmacaları çözerken veya mantıksal çıkarımlar yaparken kullandıkları, adım adım akıl yürütmeyi taklit eden algoritmalar geliştirdiler. [86] 1980’lerin sonunda ve 1990’ların sonunda, AI araştırması, olasılık ve ekonomiden kavramları kullanarak belirsiz veya eksik bilgilerle başa çıkmak için yöntemler geliştirdi . [87]

Bu algoritmalar, büyük akıl yürütme problemlerini çözmek için yetersiz olduklarını kanıtladılar çünkü “birleşik bir patlama” yaşadılar: problemler büyüdükçe katlanarak yavaşladılar. [67] İnsanlar bile, erken AI araştırmalarının modelleyebileceği adım adım çıkarımı nadiren kullanmaktadır. Sorunlarının çoğunu hızlı, sezgisel yargılarla çözerler. [88]

BİLGİ TEMSİLİ

Ontoloji, bilgiyi bir alandaki bir dizi kavram olarak ve bu kavramlar arasındaki ilişkileri temsil eder

Bilgi temsilindeki en zor sorunlar arasında şunlar yer alır:

- Varsayılan muhakeme ve yeterlilik sorunu

- İnsanların bildiği şeylerin çoğu “çalışma varsayımları” biçimini alır. Örneğin, sohbette bir kuş çıkarsa, insanlar genellikle yumruk büyüklüğünde şarkı söyleyen ve uçan bir hayvan hayal eder. Bunların hiçbiri tüm kuşlar için doğru değildir. John McCarthy , 1969’da [102] bu sorunu nitelik problemi olarak tanımladı : AI araştırmacılarının temsil etmeyi önemsediği herhangi bir sağduyu kuralı için, çok sayıda istisna olma eğilimindedir. Soyut mantığın gerektirdiği şekilde neredeyse hiçbir şey basitçe doğru veya yanlış değildir. AI araştırması, bu soruna bir dizi çözüm keşfetti. [103]

- Sağduyu bilgisinin genişliği

- Ortalama bir insanın bildiği atomik gerçeklerin sayısı çok fazladır. Sağduyu bilgisinden (örneğin, Cyc ) tam bir bilgi tabanı oluşturmaya çalışan araştırma projeleri, muazzam miktarda zahmetli ontolojik mühendislik gerektirir – her seferinde tek bir karmaşık kavram elle inşa edilmelidir. [104]

- Bazı sağduyu bilgisinin alt sembolik formu

- İnsanların bildiklerinin çoğu, sözlü olarak ifade edebilecekleri “gerçekler” veya “ifadeler” olarak temsil edilmiyor. Örneğin, bir satranç ustası belirli bir satranç pozisyonundan kaçınacaktır çünkü “fazla açıkta kalmış” [105] veya bir sanat eleştirmeni heykele bir kez bakıp bunun sahte olduğunu anlayabilir. [106] Bunlar insan beynindeki bilinçsiz ve alt sembolik sezgiler veya eğilimlerdir. [107] Bunun gibi bilgi, sembolik, bilinçli bilgi için bilgi verir, destekler ve bir bağlam sağlar. İlgili alt sembolik akıl yürütme probleminde olduğu gibi, yerleşik AI , hesaplamalı zeka veya istatistiksel AI’nın bu bilgiyi temsil etmenin yollarını sağlayacağı umulmaktadır . [107]

PLANLAMA

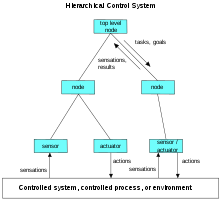

Bir hiyerarşik kontrol sistemi bir tür kontrol sistemi cihazları ve yönetim yazılımı bir dizi, bir hiyerarşi içinde düzenlenmiş olduğu.

Klasik planlama problemlerinde, temsilci, failin eylemlerinin sonuçlarından emin olmasına izin veren, dünyada hareket eden tek sistem olduğunu varsayabilir. [110] Ancak, ajan tek aktör değilse, ajanın belirsizlik altında karar vermesini gerektirir. Bu, yalnızca çevresini değerlendirip tahminlerde bulunabilen değil, aynı zamanda tahminlerini değerlendirebilen ve değerlendirmesine göre uyarlayabilen bir aracı gerektirir. [111]

Çok temsilcili planlama , belirli bir hedefe ulaşmak için birçok temsilcinin işbirliğini ve rekabetini kullanır. Bunun gibi ortaya çıkan davranışlar, evrimsel algoritmalar ve sürü zekası tarafından kullanılır . [112]

ÖĞRENME

Alanın başlangıcından bu yana yapay zeka araştırmasının temel bir kavramı olan makine öğrenimi (ML), [113] deneyim yoluyla otomatik olarak gelişen bilgisayar algoritmaları üzerine yapılan çalışmadır. [114] [115]

Denetimsiz öğrenme , bir insanın önce girdileri etiketlemesine gerek kalmadan bir girdi akışında kalıplar bulma yeteneğidir. Denetimli öğrenme , bir insanın önce girdi verilerini etiketlemesini gerektiren hem sınıflandırmayı hem de sayısal regresyonu içerir . Sınıflandırma, bir şeyin hangi kategoriye ait olduğunu belirlemek için kullanılır ve bir program birkaç kategoriden bir dizi örnek gördükten sonra gerçekleşir. Regresyon, girdiler ve çıktılar arasındaki ilişkiyi tanımlayan ve girdiler değiştikçe çıktıların nasıl değişmesi gerektiğini öngören bir işlev üretme girişimidir. [115]Hem sınıflandırıcılar hem de regresyon öğrenenler, bilinmeyen (muhtemelen örtük) bir işlevi öğrenmeye çalışan “işlev yaklaşımlayıcıları” olarak görülebilir; örneğin, bir spam sınıflandırıcı, bir e-posta metninden “spam” veya “spam değil” olmak üzere iki kategoriden birine eşleştiren bir işlevi öğreniyor olarak görülebilir. Hesaplamalı öğrenme teorisi , öğrencileri hesaplama karmaşıklığı , örnek karmaşıklığı (ne kadar veri gereklidir) veya diğer optimizasyon kavramları ile değerlendirebilir . [116] In takviye öğrenme [117] ajanı iyi yanıtlar için ödüllendirilir ve kötü olanlar için cezalandırılır. Temsilci, sorunlu alanında faaliyet göstermek için bir strateji oluşturmak için bu ödül ve ceza dizisini kullanır.

DOĞAL DİL İŞLEME

Bir Çözümleme ağacı temsil sözdizimsel bazılarına göre bir cümlenin yapısını biçimsel dilbilgisi

ALGI

Özellik algılama (resimde: kenar algılama), yapay zekanın ham verilerden bilgilendirici soyut yapılar oluşturmasına yardımcı olur.

HAREKET VE MANİPÜLASYON

AI, robotikte yoğun bir şekilde kullanılmaktadır. [127] Modern fabrikalarda yaygın olarak kullanılan gelişmiş robotik kollar ve diğer endüstriyel robotlar, sürtünme ve dişli kaymasına rağmen nasıl verimli hareket edileceğini deneyimlerden öğrenebilirler. [128] Modern bir mobil robot, küçük, statik ve görünür bir ortam verildiğinde kolayca konumunu belirleyebilir ve çevresinin haritasını çıkarabilir. Ancak, ( endoskopide ) bir hastanın nefes alan vücudunun içi gibi dinamik ortamlar daha büyük bir zorluk teşkil eder. Hareket planlamabir hareket görevini bireysel eklem hareketleri gibi “ilkellere” ayırma sürecidir. Bu tür bir hareket genellikle, hareketin bir nesneyle fiziksel teması sürdürmeyi gerektirdiği bir süreç olan uyumlu hareketi içerir. [129] [130] [131] Moravec’in paradoksu , insanların hafife aldığı düşük seviyeli duyu-motor becerilerinin bir robota programlamanın tersine, zor olduğunu genelleştirir; Paradoks, 1988 yılında “bilgisayarların zeka testlerinde veya dama oynamada yetişkin düzeyinde performans sergilemesinin nispeten kolay olduğunu ve bir yaşındaki bir çocuğun becerilerini onlara vermenin zor veya imkansız olduğunu” ifade eden Hans Moravec’in adını almıştır . algı ve hareketliliğe gelir “. [132] [133]Bu, damaların aksine, fiziksel el becerisinin milyonlarca yıldır doğal seçilimin doğrudan hedefi olduğu gerçeğine bağlanır . [134]

SOSYAL ZEKA

Temel sosyal becerilere sahip bir robot olan Kısmet [135]

Uzun vadede, sosyal beceriler ve insan duyguları ve oyun teorisi anlayışı bir sosyal ajan için değerli olacaktır. Başkalarının eylemlerini güdülerini ve duygusal durumlarını anlayarak tahmin etme yeteneği, bir temsilcinin daha iyi kararlar almasına izin verecektir. Bazı bilgisayar sistemleri, insan etkileşiminin duygusal dinamiklerine daha duyarlı görünmek veya başka şekilde insan-bilgisayar etkileşimini kolaylaştırmak için insan duygu ve ifadelerini taklit eder . [143] Benzer şekilde, bazı sanal asistanlar sohbet yoluyla konuşmak ve hatta mizahla şakalaşmak için programlanmıştır; bu, tecrübesiz kullanıcılara mevcut bilgisayar ajanlarının gerçekte ne kadar zeki olduklarına dair gerçekçi olmayan bir anlayış verme eğilimindedir. [144]

GENEL ZEKA

Tarihsel olarak, Cyc bilgi tabanı (1984–) ve devasa Japon Beşinci Nesil Bilgisayar Sistemleri girişimi (1982–1992) gibi projeler , insan bilişinin genişliğini kapsamaya çalıştı. Bu ilk projeler, nicel olmayan sembolik mantık modellerinin sınırlamalarından kaçamadı ve geçmişe bakıldığında, alanlar arası yapay zekanın zorluğunu büyük ölçüde hafife aldı. Günümüzde, çoğu mevcut AI araştırmacısı bunun yerine izlenebilir “dar AI” uygulamaları (tıbbi teşhis veya otomobil navigasyonu gibi) üzerinde çalışıyor. [145] Birçok araştırmacı, farklı bireysel alanlarda bu tür “dar yapay zeka” çalışmalarının sonunda yapay genel zekaya sahip bir makineye dahil edileceğini tahmin ediyor(AGI), bu makalede bahsedilen dar becerilerin çoğunu birleştiriyor ve bir noktada bu alanların çoğunda veya tümünde insan yeteneğini bile aşıyor. [20] [146] Birçok ilerlemenin genel, alanlar arası önemi vardır. Yüksek profilli bir örnek, 2010’larda DeepMind’in birçok farklı Atari oyununu kendi başına öğrenebilen “genelleştirilmiş bir yapay zeka” geliştirmesi ve daha sonra sıralı öğrenmeyi başaran bir sistem varyantı geliştirmesidir . [147] [148] [149] Transfer öğrenmenin yanı sıra , [150]Varsayımsal AGI atılımları, karar-teorik metareonizasyonla uğraşabilen yansıtıcı mimarilerin geliştirilmesini ve tüm yapılandırılmamış Web’den kapsamlı bir bilgi tabanının nasıl “bulandırılacağını” bulmayı içerebilir . [7] Bazıları bir tür (şu anda keşfedilmemiş) kavramsal olarak basit, ancak matematiksel olarak zor olan “Ana Algoritma” nın AGI’ye yol açabileceğini iddia ediyor. [151] Son olarak, birkaç “yeni ortaya çıkan” yaklaşım, insan zekasını son derece yakından simüle etmeye çalışıyor ve yapay beyin veya simüle edilmiş çocuk gelişimi gibi antropomorfik özelliklerin bir gün genel zekanın ortaya çıktığı kritik bir noktaya ulaşabileceğine inanıyor . [152][153]

Makineler sorunları insanlar kadar çözecekse, bu makaledeki sorunların çoğu genel zeka gerektirebilir. Örneğin, makine çevirisi gibi belirli basit görevler bile , bir makinenin her iki dilde de okuyup yazmasını ( NLP ), yazarın argümanını ( nedenini ) takip etmesini , ne hakkında konuşulduğunu bilmesini ( bilgi ) ve yazarın orijinalini aslına uygun şekilde yeniden üretmesini gerektirir. Makine çevirisi gibi bir sorun ” yapay zeka tamamlandı ” olarak kabul edilir, çünkü insan düzeyinde makine performansına ulaşmak için tüm bu sorunların aynı anda çözülmesi gerekir.

KAYNAKÇ A

|